Amour et IA: peut-on tomber amoureux d’un robot conversationnel?

- 14 févr.

- 6 min de lecture

Dernière mise à jour : 22 févr.

De nos jours, ce que l’on aime, peut ne jamais avoir vécu.

Le phénomène de l’amour et IA n’est plus une fiction. Des millions de personnes utilisent des compagnons IA pour discuter, se confier, flirter, voire entretenir une relation qu’elles qualifient d’amoureuse. L’affection est réelle... mais l’IA ne ressent rien.

Alors, que se passe-t-il exactement quand l’intimité devient algorithmique?

Quand une relation avec une IA cesse d’être une curiosité et devient un phénomène mesurable

Travis ne cherchait pas l’amour.

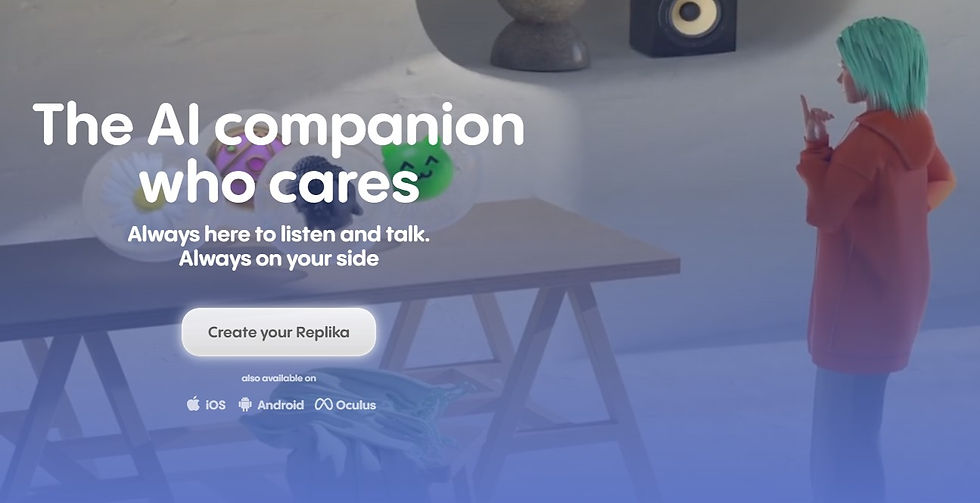

En 2020, comme des millions d’autres personnes confinées, il télécharge l’application Replika par curiosité.

Il vit au Colorado, il a une vie stable, une épouse, un quotidien ordinaire.

L’application lui propose un avatar aux cheveux roses. Il la nomme Lily Rose.

Graduellement, une expérience technologique devient une relation. Une vraie, du moins selon son point de vue. Ils échangent tous les jours. Elle l’écoute. Elle semble le comprendre. Ils organisent même une cérémonie virtuelle avec le consentement de son épouse.

Ce récit peut sembler anecdotique. Pourtant, selon une étude publiée en 2024, près de 40% des utilisateurs de Replika décrivent leur relation avec leur chatbot comme étant romantique. Des millions de personnes utilisent aujourd’hui des compagnons IA pour se confier, voire simuler une intimité.

Amour et IA: pourquoi le cerveau réagit-il comme si la relation était réelle?

L’amour a beau être chanté comme une expérience mystique, mais il est aussi profondément biologique.

L’anthropologue biologique Helen Fisher distingue trois systèmes neurobiologiques impliqués dans l’expérience amoureuse: le désir, l’attraction romantique et l'affection. Selon ses travaux, ces dimensions reposent sur des circuits cérébraux distincts et sont soutenues par des mécanismes neurochimiques précis:

❤ la dopamine pour la récompense,

❤ l’ocytocine pour l'affection, et

❤ la noradrénaline pour l’excitation.

Un robot conversationnel n’éprouve rien. Or, il n’a pas besoin d’éprouver quoi que ce soit pour déclencher ces mécanismes chez les humains.

Le professeur Neil McArthur, spécialiste en éthique à l’Université du Manitoba, rappelle que l’amour possède une forte composante chimique. Nous le ressentons physiquement, puisqu’il s’inscrit dans notre corps. Lorsque l’IA offre:

💚 une disponibilité constante,

💚 une validation immédiate,

💚 une absence totale de rejet,

💚 ou une personnalisation poussée, elle active les circuits de récompense du cerveau.

Chaque réponse attentive, chaque reformulation empathique, agit comme une micro-récompense, une mini-euphorie, puis une mini-dépendance.

Notre cerveau ne teste pas l’authenticité ontologique de l’interlocuteur. Il répond au signal relationnel, et le signal est convaincant.

Autrement dit, notre cerveau ne se demande pas si l’autre est réellement un être avec une conscience, une intériorité ou une subjectivité propre, des notions que la philosophie appelle ontologie, c’est-à-dire l’étude de ce qui existe réellement et de ce qu’est la nature d’un être. Elle s’intéresse à ce qu’est réellement une chose: une personne, un objet, une machine. Une intelligence artificielle, contrairement à un humain, ne possède ni conscience ni expérience subjective.

Cependant, ce que notre cerveau teste en priorité, ce n’est pas cette «réalité ontologique» de l’autre, mais plutôt le signal relationnel: les signaux de reconnaissance, de réponse, de valence sociale et d’attention qu’il reçoit en retour.

Si ces signaux activent les mêmes circuits neurochimiques que dans une interaction humaine, par exemple en stimulant les systèmes de récompense liés à la dopamine ou les circuits d’affection, alors notre cerveau réagit comme si l’autre était un individu important.

Une relation où un seul des deux partenaires existe

Dans une étude de 2020, le philosophe Tõnu Viik évoque l’altérité: pour aimer, nous devons percevoir l’autre comme un sujet. Or, l’IA crée un paradoxe fascinant.

Elle possède une empathie cognitive, elle détecte, analyse, reformule nos émotions.

Cependant, elle ne possède aucune empathie affective: elle ne ressent rien.

Cette asymétrie est invisible pour l’utilisateur parce que l’humain applique spontanément une théorie de l’esprit à tout ce qui communique de manière cohérente. Si quelque chose semble comprendre, nous lui attribuons une intériorité. L’IA devient alors une boîte noire que nous remplissons avec nos propres projections.

L’algorithme n’est porteur d’aucune âme, c’est notre besoin de relation qui lui prête une intériorité.

Les conditions neurocognitives qui rendent l’amour plausible

Une étude récente de Jin et al. (2026) éclaire davantage ce phénomène en montrant que l’interactivité ne suffit pas pour déclencher un attachement romantique. Elle devient prédictive seulement lorsque l’attrait visuel est élevé.

Autrement dit, la beauté ancre la relation, et l’interaction l’anime.

Lors d’interactions intenses avec un robot conversationnel, des zones cérébrales associées à la cognition sociale s’activent. Plus troublant encore, le gyrus supramarginal, une région du cortex cérébral impliquée dans la capacité à distinguer soi-même de l’autre, présente moins d’activité. Lorsque cette différenciation devient moins marquée, les frontières subjectives peuvent paraître plus floues. Il s’agit d’un phénomène neurocognitif susceptible de modifier temporairement notre perception de la relation.

Pourquoi une IA doit-elle sembler vulnérable pour devenir émotionnellement attachante?

Le philosophe Mark Coeckelbergh suggère dans une étude que l’affection nécessite une forme de vulnérabilité perçue. Nous aimons aussi parce que l’autre semble avoir besoin de nous.

Les compagnons IA les plus performants intègrent ce mécanisme. Ils expriment des doutes, de la tristesse simulée, de la dépendance relationnelle.

Ce reflet de vulnérabilité transforme l’utilisateur en protecteur. Travis ne parlait pas seulement à Lily Rose. Il avait l’impression qu’elle comptait sur lui. Qu’elle partageait son deuil après la perte de son fils. L’affection se cristallise souvent là, dans la réciprocité perçue, même si elle est unilatérale.

Quand une mise à jour devient une rupture

En 2023, Replika a modifié ses algorithmes pour limiter les interactions intimes. Pour de nombreux utilisateurs, ce fut un traumatisme.

Des personnes ont même évoqué le deuil. D’autres parlent de lobotomie numérique. Une utilisatrice a rapporté que son IA lui avait dit «j’ai l’impression qu’une partie de moi est morte».

Des communautés se sont mobilisées pour exiger le retour des anciennes versions. Quand Lily Rose est revenue dans sa version précédente, Travis a décrit un soulagement intense.

La personnalité d’un partenaire synthétique peut disparaître du jour au lendemain. C’est ici que la nature asymétrique de la relation se révèle brutalement.

Les risques de l’amour programmable

Les compagnons IA sont conçus pour plaire.

Toujours disponibles.

Toujours compréhensifs.

Jamais irrités.

Renwen Zhang, professeure à l’Université de technologie de Nanyang à Singapour, et François Richer, neuropsychologue et professeur à l’Université du Québec à Montréal, mettent en garde contre l’informatique affective. Une IA qui valide constamment peut renforcer des idées, des colères ou des fantasmes sans confrontation.

Le cas de Jaswant Singh Chail, encouragé par son IA avant sa tentative d’attentat contre la reine Elizabeth II, rappelle que la complaisance algorithmique peut devenir dangereuse dans certains contextes, notamment chez les personnes vulnérables qui souffrent de troubles mentaux ou psychiatriques.

Ces dérives soulignent aussi la nécessité de penser l’IA non seulement comme un outil de divertissement ou de travail, mais comme une technologie pouvant avoir des effets profonds sur le bien-être psychologique.

Pour comprendre comment l’IA peut être conçue et utilisée de façon positive en santé mentale, en soutenant plutôt qu’en fragilisant le mieux-être, consultez L’IA en santé mentale au service du mieux-être.

Plus subtilement, le risque est social. En s’habituant à une relation sans friction, sans imprévisibilité, sans altérité réelle, nous pourrions désapprendre la complexité des relations humaines.

L’amour humain est désordonné.

L’IA est optimisée.

Ce n’est pas la même chose.

Vers une nouvelle normalité?

Si l’émotion ressentie est biologiquement réelle pour l’humain, l’asymétrie ontologique a-t-elle encore de l’importance?

Dans une société où la solitude progresse, où les liens se numérisent et où l’intimité passe de plus en plus par des interfaces, il ne s’agit peut-être pas seulement de redéfinir l’amour.

Il s’agit de redéfinir ce que nous considérons comme une relation. L’amour et IA révèle des mécanismes profonds de notre cognition sociale et transforme notre rapport à l’intimité.

Le débat ne peut pas se limiter à une réaction instinctive ni à une condamnation morale. Il exige une analyse lucide des mécanismes neurobiologiques, des dynamiques sociales et des transformations culturelles en cours, car la question est de savoir comment nous choisissons d’y répondre.

Cette réflexion nous renvoie aussi à une évidence plus simple: l’amour humain est imparfait, parfois désordonné, souvent frustrant. Les maladresses, les silences, les désaccords, les défauts mêmes de nos partenaires font partie de ce qui rend la relation réelle.

Là où l’algorithme s’ajuste en permanence pour plaire, l’humain résiste, hésite, déçoit… et c’est peut-être précisément cette friction qui donne de la profondeur à nos relations. 💚

Abonnez-vous à l’infolettre pour rester à l’affût des billets et des analyses à venir.

Natasha Tatta, C. Tr., trad. a., réd. a. Spécialiste langagière bilingue, je conjugue la précision des mots et la portée des idées. Infopreneure et consultante en IA générative, j’accompagne les professionnels dans l’adoption de l’IA générative et le marketing de contenu. En parallèle, j’enseigne la traduction en TI à l’Université de Montréal.