Intelligence artificielle payante sans transparence: un abonnement risqué

- 14 avr.

- 3 min de lecture

Avez-vous déjà atteint la limite d’utilisation d’un outil sans comprendre pourquoi? Vous n’êtes pas seul·e.

Voici mes réflexion sur les outils actuels, en particulier sur les modèles d’IA payants, dans un contexte où l’on observe de plus en plus une intelligence artificielle payante sans transparence. Il existe des modèles à code source ouvert et gratuits, mais le problème se situe surtout du côté des outils payants avec un abonnement.

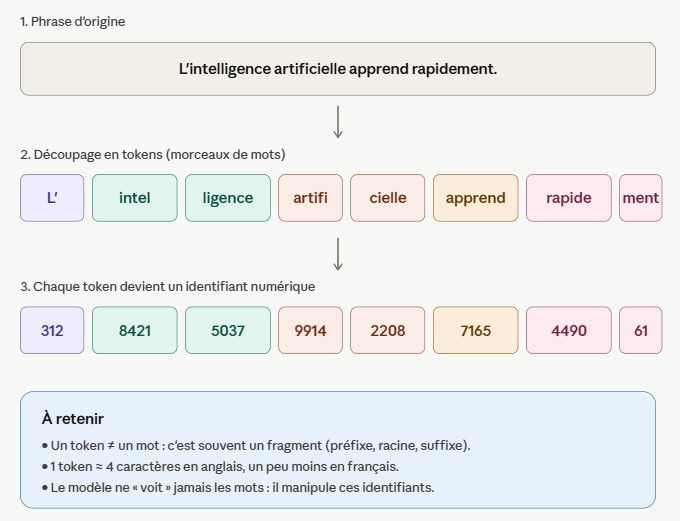

Ce qui ressort, c’est un manque généralisé de transparence. Cela touche autant les limites d’utilisation que la puissance de calcul et la consommation de jetons (token), un facteur qui touche une unité de mesure floue pour l’utilisateur.

Après plusieurs années d’expérimentation, un constat s’impose: la performance n’est pas

constante. En prenant des exemples comme OpenAI ou Anthropic, et même Google dans

une certaine mesure, le même problème se répète.

Les limites existent, mais elles sont mal définies. Elles sont souvent exprimées en pourcentage, sans que l’on sache ce que cela représente réellement.

Contrairement à une mesure claire comme des litres d’essence, ici, on parle de 100%

d’utilisation sans jamais préciser de quoi il s’agit. Il devient alors impossible d’évaluer ce

que l’on consomme réellement, et de comparer les offres entre elles.

Contexte d’utilisation et de performance de l’intelligence artificielle payante sans transparence

Dans l’usage concret, les limites deviennent encore plus visibles. Des entreprises, comme Anthropic, imposent des restrictions sur des périodes précises, par exemple des cycles de cinq heures pour utiliser Claude. On peut atteindre ces limites en plein travail, ce qui crée une interruption directe dans le flux de production.

Au-delà des limites, il y a aussi une variation notable de la qualité. Pour une même requête

avec les mêmes informations, le résultat peut passer d’excellent à très faible. Ce n’est pas une simple variation liée à la nature probabiliste des modèles. Dans certains cas, la baisse est suffisamment marquée pour être évidente.

On a l’impression que les fournisseurs ajustent de manière dynamique la puissance des modèles d’IA selon l’utilisation globale, comme une gestion de pression dans un réseau.

Plus il y a d’utilisateurs, plus la performance semble diminuer. Le problème est que ce comportement n’est jamais explicité, donc l’utilisateur ne sait jamais la puissance réelle de l’outil utilisé. Dans un contexte professionnel, cette instabilité pose un problème important. On ne veut pas dépendre d’un outil dont la performance et l’accessibilité varient sans avertissement.

Contexte économique et dépendance

De surcroit, ce problème dépasse la simple expérience utilisateur, car il devient économique et stratégique. Des utilisateurs rapportent, notamment sur Reddit, une diminution progressive des limites d’utilisation des outils avec le temps. Autrement dit, pour un abonnement identique, la valeur réelle diminue.

Dans ce contexte, payer d’avance devient risqué. Si le service évolue à la baisse sans

transparence, il devient impossible de garantir la valeur réelle de l’investissement. Le marché est dominé par quelques acteurs, ce qui limite les options. L’utilisateur n’a donc pratiquement aucun levier. Il ne dispose pas de données claires pour comparer, et la seule action possible reste le désabonnement.

Cependant, se désabonner n’est pas une solution viable lorsqu’on dépend de ces outils pour travailler ou lorsqu’un paiement a déjà été effectué, ce qui crée une forme de dépendance. Sans dire qu’on est pris à la gorge, il reste très peu de marge de manœuvre réelle.

Réflexion et pistes

Face à cette situation, il devient pertinent d’envisager d’autres approches. Une stratégie consiste à utiliser plusieurs outils d’IA en parallèle et à répartir le budget, ce qui permet de limiter la dépendance à un seul fournisseur et d’ajuster l’utilisation selon ses besoins.

Une autre option est de se tourner vers des modèles à code source ouvert ou des solutions

en local. Ces approches offrent une meilleure stabilité et un contrôle complet sur la

performance, puisque tout repose sur le matériel utilisé.

Ces solutions demandent plus d’efforts techniques, mais elles apportent une

transparence et une constance que les modèles commerciaux ne garantissent pas actuellement.

L’enjeu réel de l’intelligence artificielle payante sans transparence

Au final, la réflexion repose sur un point central: tant que les modèles payants resteront

opaques sur leurs limites et leurs performances, ils poseront un problème incontestable pour une utilisation sérieuse et professionnelle. Pour aller plus loin et structurer votre utilisation de l’IA dans une approche claire et maîtrisée, visitez mon site Web ou contactez-moi à l'adresse info@jimmygilbert.com

Jimmy Gilbert, Conseiller et formateur en technologie. Enseignant en informatique au Cégep de Sainte-Foy, Jimmy évolue à la croisée de la pédagogie, du développement logiciel et de l’intelligence artificielle. Il forme la relève en combinant rigueur technique et vision concrète du marché du travail, tout en intégrant activement les outils d’IA dans ses pratiques. Parallèlement, il agit comme coach technologique, accompagnant particuliers et professionnels dans l’adoption efficace des technologies, de l’automatisation et de l’IA.